Table des matières:

- Auteur Miles Stephen stephen@answers-science.com.

- Public 2023-12-15 23:36.

- Dernière modifié 2025-01-22 16:58.

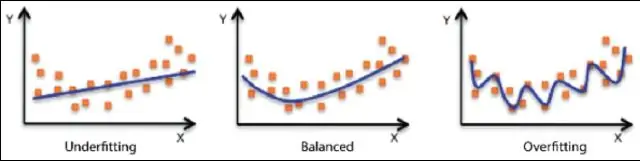

La régression non linéaire peut s'adapter à beaucoup plus de types de courbes, mais il pouvez nécessitent plus d'efforts à la fois pour trouver le meilleur ajustement et pour interpréter le rôle des variables indépendantes. De plus, R-carré n'est pas valable pour régression non linéaire , et il est impossible de calculer valeurs de p pour les estimations de paramètres.

De cette façon, une régression peut-elle être non linéaire ?

En statistiques, régression non linéaire est une forme de régression analyse dans laquelle les données d'observation sont modélisées par une fonction qui est un non linéaire combinaison des paramètres du modèle et dépend d'une ou plusieurs variables indépendantes. Les données sont ajustées par une méthode d'approximations successives.

On peut aussi se demander si r est au carré uniquement pour la régression linéaire ? Le cadre mathématique général de R - au carré ne fonctionne pas correctement si le Modèle de régression n'est pas linéaire . Malgré ce problème, la plupart des logiciels statistiques calculent toujours R - au carré pour les modèles non linéaires. Si tu utilises R - au carré choisir le meilleur maquette , cela conduit à la bonne modèle seulement 28-43% du temps.

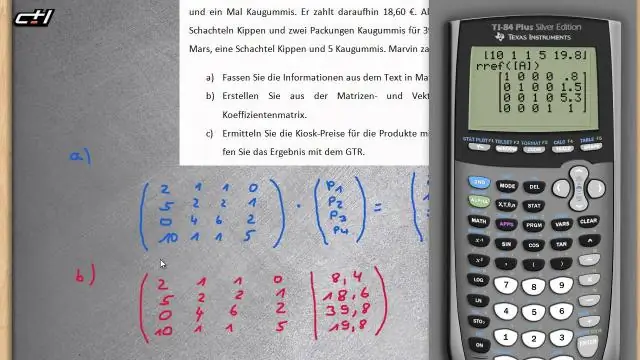

À ce sujet, comment calculez-vous la régression non linéaire ?

Si votre modèle utilise un équation sous la forme Y = a0 + b1X1, c'est un régression linéaire maquette. Si non, c'est non linéaire.

Y = f(X,) + ε

- X = un vecteur de p prédicteurs,

- β = un vecteur de k paramètres,

- f(-) = une fonction de régression connue,

- = un terme d'erreur.

Quels sont les types de régression ?

Types de régression

- Régression linéaire. C'est la forme la plus simple de régression.

- Régression polynomiale. C'est une technique pour ajuster une équation non linéaire en prenant des fonctions polynomiales de variable indépendante.

- Régression logistique.

- Régression quantile.

- Régression de crête.

- Régression au lasso.

- Régression nette élastique.

- Régression en Composantes Principales (PCR)

Conseillé:

En quoi la résolution d'inéquations linéaires et d'équations linéaires sont-elles similaires ?

La résolution d'inéquations linéaires est très similaire à la résolution d'équations linéaires. La principale différence est que vous renversez le signe de l'inégalité lorsque vous divisez ou multipliez par un nombre négatif. La représentation graphique des inégalités linéaires présente quelques différences supplémentaires. La partie ombrée comprend les valeurs où l'inégalité linéaire est vraie

Comment faire une régression sinusoïdale sur une calculatrice ?

VIDÉO Ici, comment calculez-vous la régression sinusoïdale? Régression sinusoïdale . Ajustez les valeurs de A, B, C et D dans le équation y = A*sin(B(x-C))+D pour faire un sinusoïdal la courbe correspond à un ensemble donné de données générées aléatoirement.

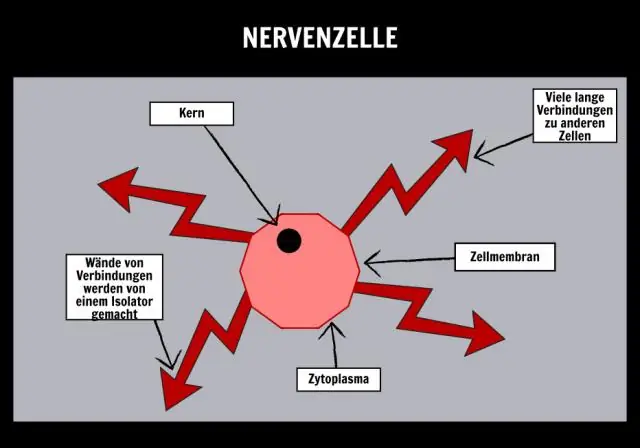

Comment les structures cellulaires permettent-elles à une cellule d'effectuer des processus vitaux de base ?

Des cellules spécialisées remplissent des fonctions particulières, telles que la photosynthèse et la conversion d'énergie. place du cytoplasme qui est entouré d'une membrane cellulaire et effectue les processus vitaux de base. et l'organite dans une cellule effectue certains processus, tels que la fabrication ou le stockage de substances, qui aident la cellule à rester en vie

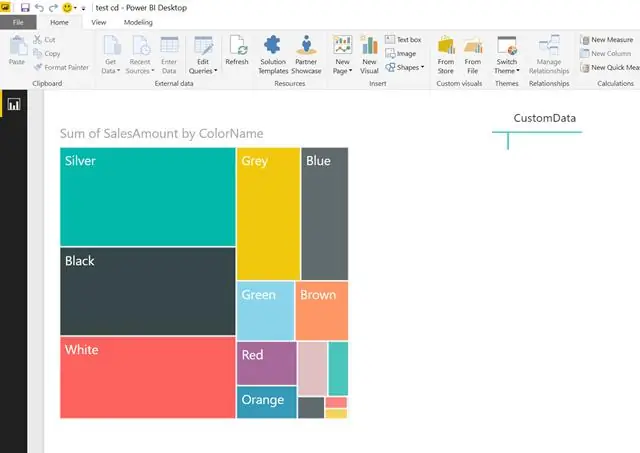

Quelle méthode de classification des données place un nombre égal d'enregistrements ou d'unités d'analyse dans chaque classe de données ?

Quantile. chaque classe contient un nombre égal de caractéristiques. Une classification quantile est bien adaptée aux données distribuées linéairement. Quantile attribue le même nombre de valeurs de données à chaque classe

Quelle caractéristique des données est une mesure de la quantité que les données valorisent vraiment ?

Variation : mesure de la variation des valeurs des données. ? Distribution : La nature ou la forme de la diffusion des données sur la plage de valeurs (comme en forme de cloche). ? Valeurs aberrantes : valeurs d'échantillon très éloignées de la grande majorité des autres valeurs d'échantillon